对于任何一位真正上手做过工程的地震深度学习从业者而言,这几乎是一个必须经历的绝望时刻:你满怀期待地从 GitHub 上克隆了一个在世界级数据集(比如主要由加州构造地震构成的巨型语料库)上大杀四方、指标完美无瑕的深层神经网络,连夜将权重矩阵原封不动地迁移过来,试图直接将它硬怼到俄克拉荷马州(Oklahoma)那些由于工业废水回注而引发的诱发地震(Induced Seismicity)数据上。紧接着,你就会迎头撞上一模一样、极其残酷的物理现实:模型的检测性能出现断崖式的疯狂崩塌。

那些看似牢不可破的底层算法与数学公式并没有突然失效,失效的是数据背后的物理世界。源区分布彻底变了、波形的统计先验特征面目全非、震级-频度关系(b值)偏离了原始预期、震源机制甚至由于注水断层激活而拥有着截然不同的几何形态,那些深埋于地壳中的衰减结构更是相去甚远。

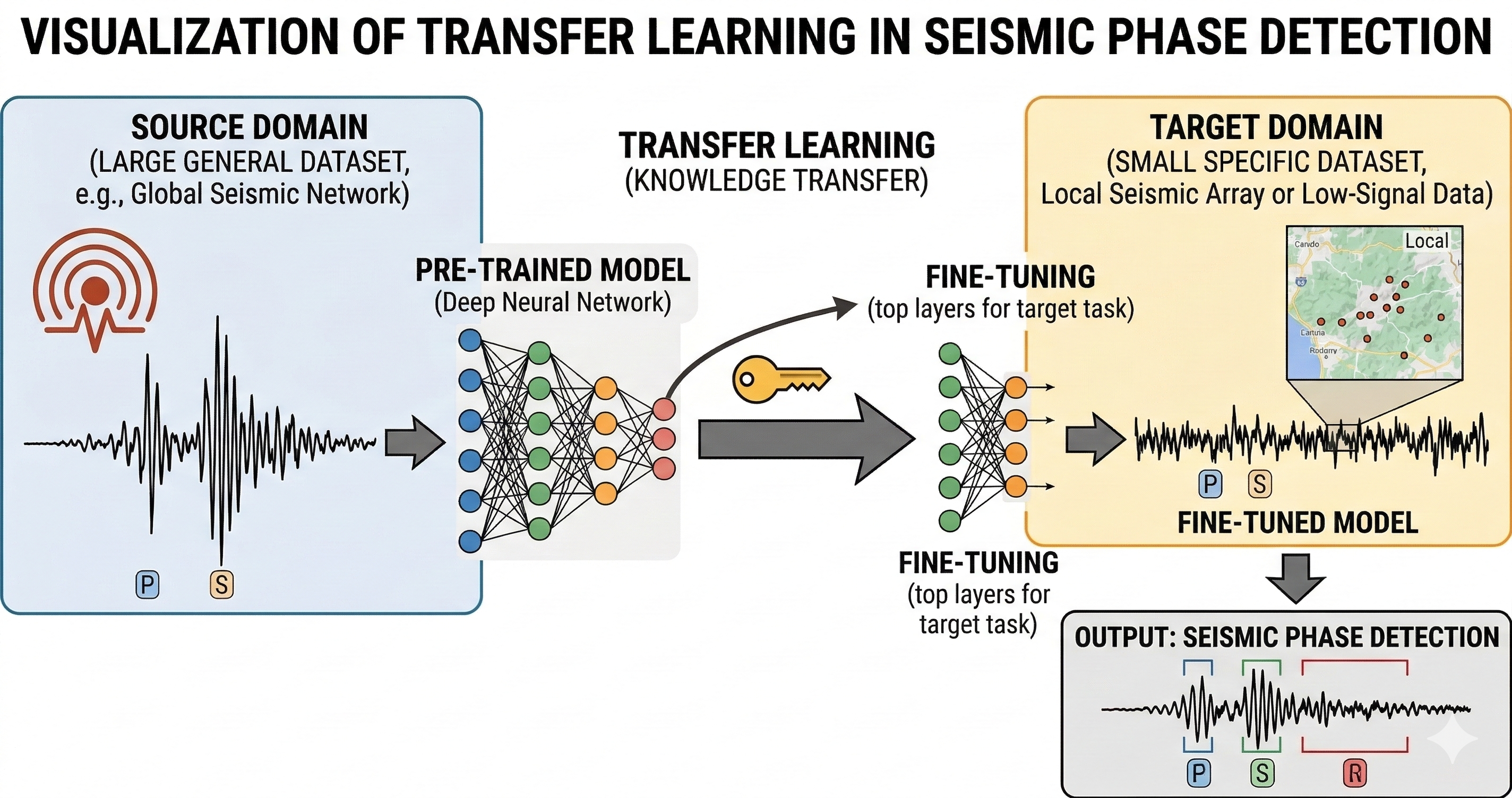

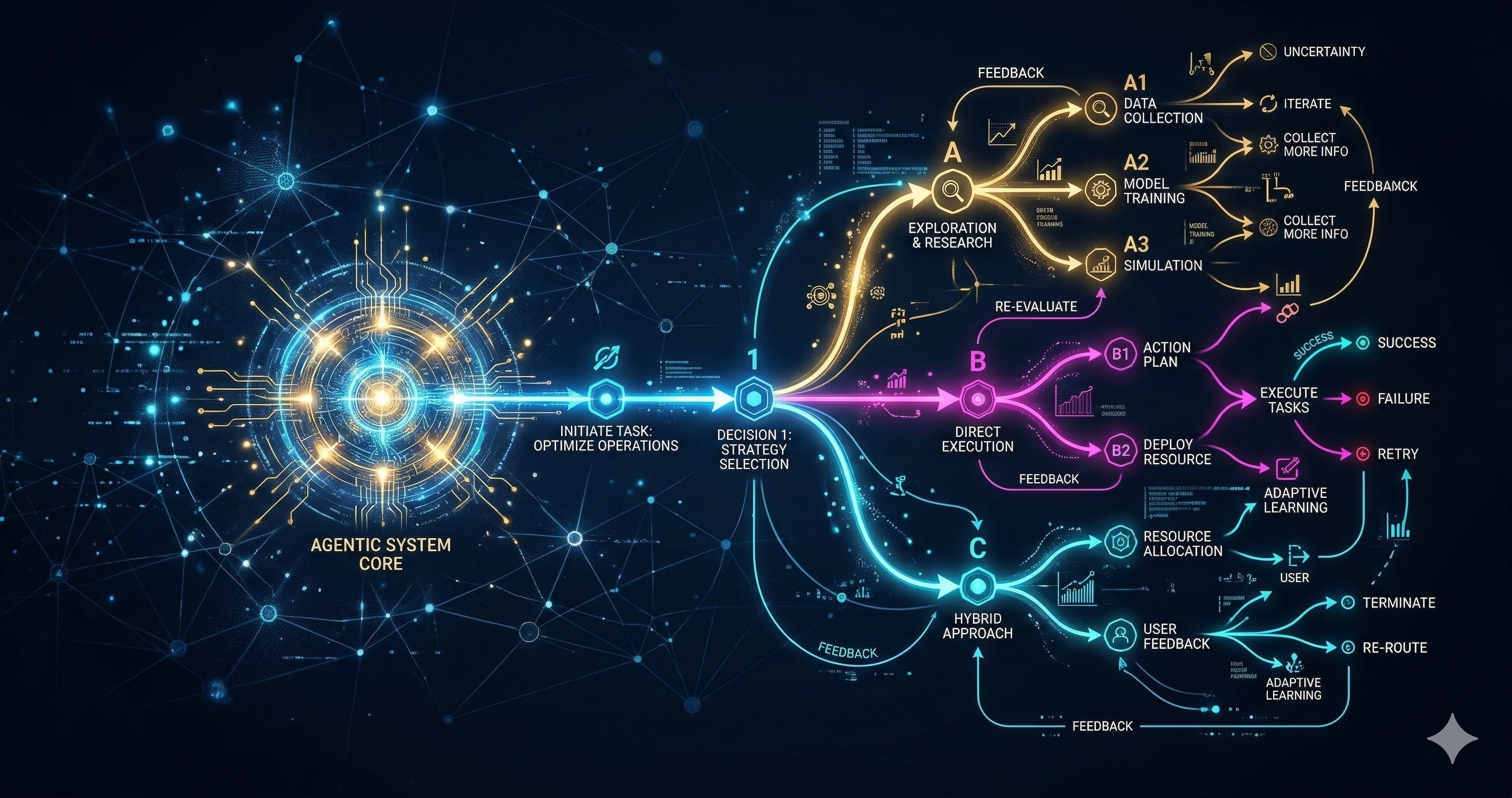

这种令人窒息的现象,在机器学习的学术语境中被称为领域偏移(Domain Shift)。它无情地指出了一个模型在其最初受训获得的“源数据分布(Source Distribution)”与它被扔进真实的业务荒野后所面对的“目标数据分布(Target Distribution)”之间,存在着一条深不见底的统计鸿沟。迁移学习(Transfer Learning)当然不是某种能凭空抹平这条鸿沟的数字魔门,但它确实为我们在这些截然不同的物理时空之间,搭建了一排坚实、且在数学上绝对严谨的浮桥。

物理视角的解构:领域偏移从何而来?

想要彻底弄明白那些百亿参数的庞然大物为何会在跨越州界后轰然倒塌,我们就必须抛弃对代码的盲目崇拜,重新捡起最硬核的波动传播物理学。

在检波器上被数字化的那一串看似随机的震动波形时间序列,本质上是三股极其复杂物理效应的超级卷积:首先是深层断层破裂滑移的那个原始心跳(源效应,Source Mechanism),其次是地震波在撕裂冰冷坚硬的大陆地壳时所经历的漫长跋涉、严重几何扩散和高频散射损耗(路径效应,Path Effect),最后是传感器正下方的那个浅层土层(比如你恰好把台站修在了无比松软厚实的第四纪沉积盆地上空)对波形进行的剧烈地形放大与共振畸变(场地效应,Site Effect)。

一个在海量的南加州地震台网(SCSN)历史目录上被日头夜里喂养出来的模型,其实就像是在不知不觉中患上了严重的“加州路径场地依赖症”。而当它被强行空投到中大陆的俄克拉荷马州——那里挤满了被油气开采高压注水强行唤醒的极浅层微震,波动在深厚沉积岩中穿梭——这个可怜的神经网络突然发现:高频信号为什么衰减得如此迅猛?尾波(Coda Wave)怎么拖得这么长?所有的波形分布特征,它之前根本就没有在它所谓的“全局知识库”中见过。

深究一个神经网络:到底什么知识是可以被“打包带走”的?

在那些专为地震震相拾取(Phase Picking)量身定制的深层卷积神经网络(CNN,例如大名鼎鼎的 PhaseNet 或 EQTransformer)内部,学习过程是呈现出极其严格的层级递进(Hierarchical)结构的。

网络中那些最底层的计算模块(即最靠近原始输入波形的头几层卷积核),它们如同最纯粹的物理原教旨主义者,只负责学习最具通用性的底层波形肌理:例如起震瞬间的绝对锐度、纯粹的时域包络形状、以及未经雕琢的基础频段构成。

令人欣慰的是,这些底层的、如同本能般的基础特征矩阵(Features),展示出了极其强悍的跨洋甚至跨州迁移能力(Transferability)。这是因为无论断层处于何等奇异的构造环境,纵波(P-wave)那如被锤击般的压缩属性,和横波(S-wave)如蛇行般的剪切属性,在本质的基础物理学层面上始终遵循着同一套牛顿力学框架。只要波还是那种波,锐利依然是锐利。

然而,到了网络最深处、最高层的抽象决策层,情况发生了逆转。这些处于网络末端的全连接(Dense)层,深深地编码了那些只属于训练地本土的、极度狭隘且领域限定(Domain-specific)的复杂决策边界。它们被当地特有的交通噪音、工业背景脉动以及极度特定的路径衰减特性死死绑架了。想要把整个模型部署到新的地震区,这几层高阶抽象层几乎无一例外地需要被毫不留情地切除重启、或是进行极其激进的微调(Fine-tuning)。

对阵俄克拉荷马:目标领域的实战挣扎与反击

针对俄克拉荷马州诱发微地震的智能监测系统,向当前所有最先进的预训练大模型提出了极其严苛、甚至可以说是地狱级的挑战。

这里的地震因为由高压废水的大规模地下灌注触发,在空间和时间尺度上呈现出极其恐怖的强丛集性(Clustering)。常常是一波群震像机关枪一样重叠爆发,大量本就只有里氏零级或是一级的微弱发作,其微弱的 P/S 波能量几乎被完全埋葬在连续不断的背景环境噪声(Noise Floor)之下。

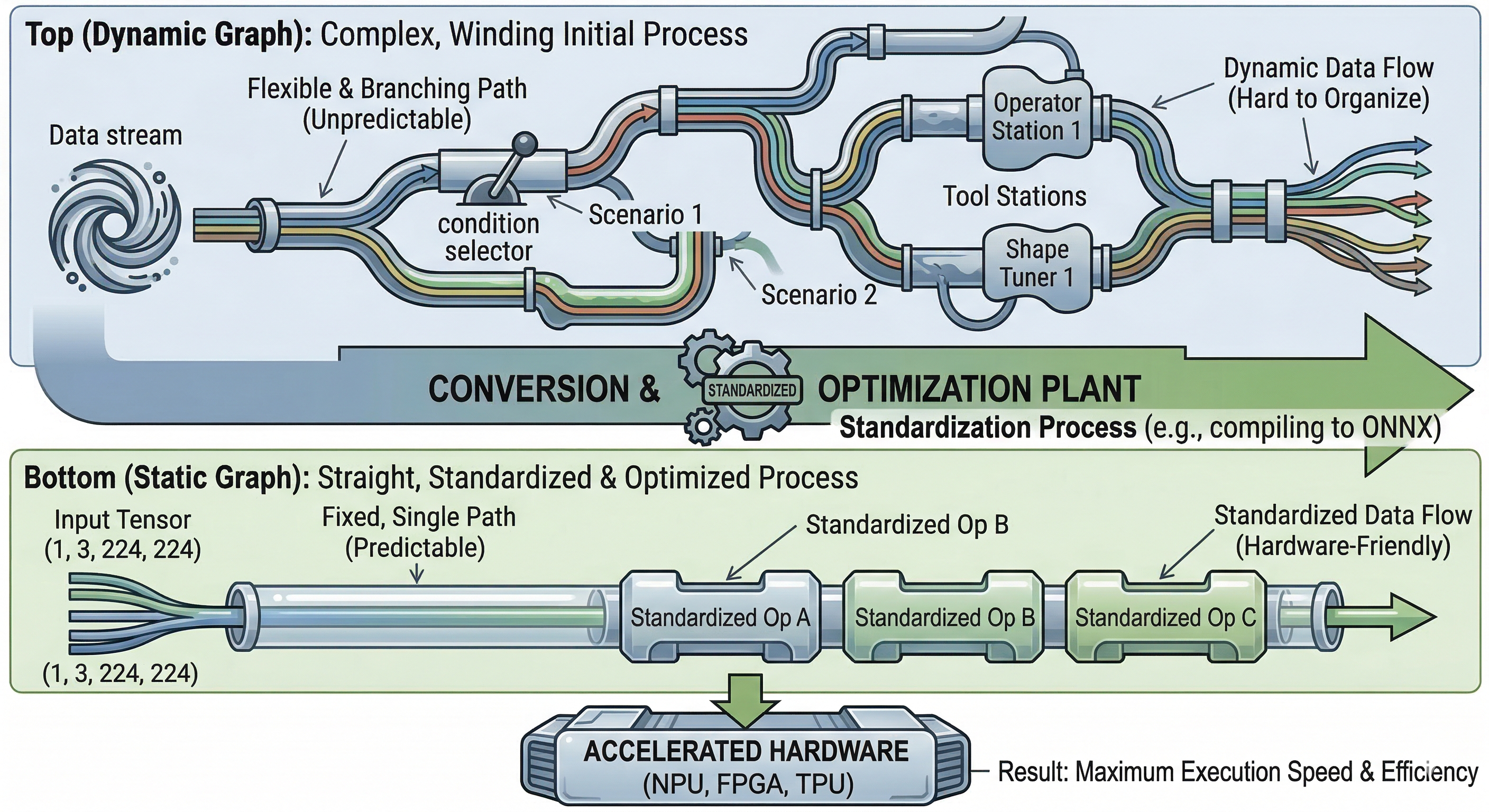

因此,面对真实世界,那些在斯坦福超级地震数据集(STEAD)或类似全球普适语料库上用无数显卡堆出来的基础大模型(Foundation Models),在真正落地之前,必须经历极其痛苦的在地化改造,否则它们连一个有经验的地质大学本科实习生的肉眼识别率都比不过。

在我过去负责将经过知识蒸馏(Knowledge Distillation)压缩过的端侧残差网络模型部署到前线的研究中,我反复确认了一个极具希望的结论:你甚至不需要海量的数据。只要我用区区几千个由俄克拉荷马地质调查局(OGS)台网当地分析师精心手工标注过的高质量地震事件,作为极少量但绝对纯正的目标域样本去对 STEAD 预训练模型进行定点微调(解冻最后几层),系统就能瞬间弥合整整 80% 的模型预测断层。而剩下那最后 20% 的硬骨头缺口,通常集中在那些震级接近 M 0.0、信噪比极其微弱且完全被区域特定风噪或车流覆盖的隐匿震相中,那里的领域偏移(Domain Shift)才真正占据了压倒性的统治地位。

极少样本适应(Few-Shot)与数据孤岛工程的救赎

迁移学习最伟大、甚至可以说是最功利的工程学价值,完全超脱了单纯的“提升零点几个百分点的精度”——它带来了让人瞠目结舌的数据效率(Data Efficiency)。

如果某个资金捉襟见肘的区域级地方地震局,妄图从头开始(From Scratch)走完全监督学习的道路、去生生攒出一个鲁棒性极强的自动化拾取系统,他们通常需要硬扛下几十万级的波形手工标注工作量。换算成顶级地质研究员不眠不休的肉眼标图时间,这笔开支可以直接击垮整个项目的预算审批。

而通过带有极强针对性的迁移微调策略(例如,我们彻底锁死、冻结住网络前四大包含几百万参数的卷积核心提取模块,而仅仅用极其微弱的学习率去耐心打磨最后一层的那个全连接映射),整个团队往往只需要不到两三千条本震区的纯净数据,就能毫不费力地打平哪怕是从头训练几十万条数据才可能摸到的高水位线,甚至表现更加惊艳。

对于那些没有丰厚历史遗留资产的年轻台网,或者那些长期以来数据标注质量参差不齐、标注员经常换人的地方局来说,迁移学习绝对不仅仅是一个在顶级会议上用来炫技的巧妙算法——在预算枯竭和期限高压的现实世界里,它经常是我们把深度学习真正推向生产线部署时,唯一点亮的那条逃生通道。

成为第一个评论者。