在开发机器学习模型时,PyTorch 无疑是绝大多数研究人员的首选框架。它那符合直觉的动态计算图(Dynamic Computational Graph)和高度 Python 化的 API 设计,为算法实验提供了极大的便利。在研究阶段,无论是随时修改前向传播链路,还是逐行调试张量维度、动态打印梯度,这种体验都是无与伦比的。然而,当模型走出实验室、迈向生产环境部署(Production Deployment)时,如果仅仅依赖 PyTorch 原生的 .pth 格式,往往会带来不必要且极其严重的性能瓶颈。

将模型从 PyTorch 转换为 ONNX(Open Neural Network Exchange)格式,远不止是一个简单的格式兼容步骤,或者上线前的例行公事。事实上,这是提升推理速度最直接、最有效的方法之一,并且几乎不需要进行任何有损的深入优化。

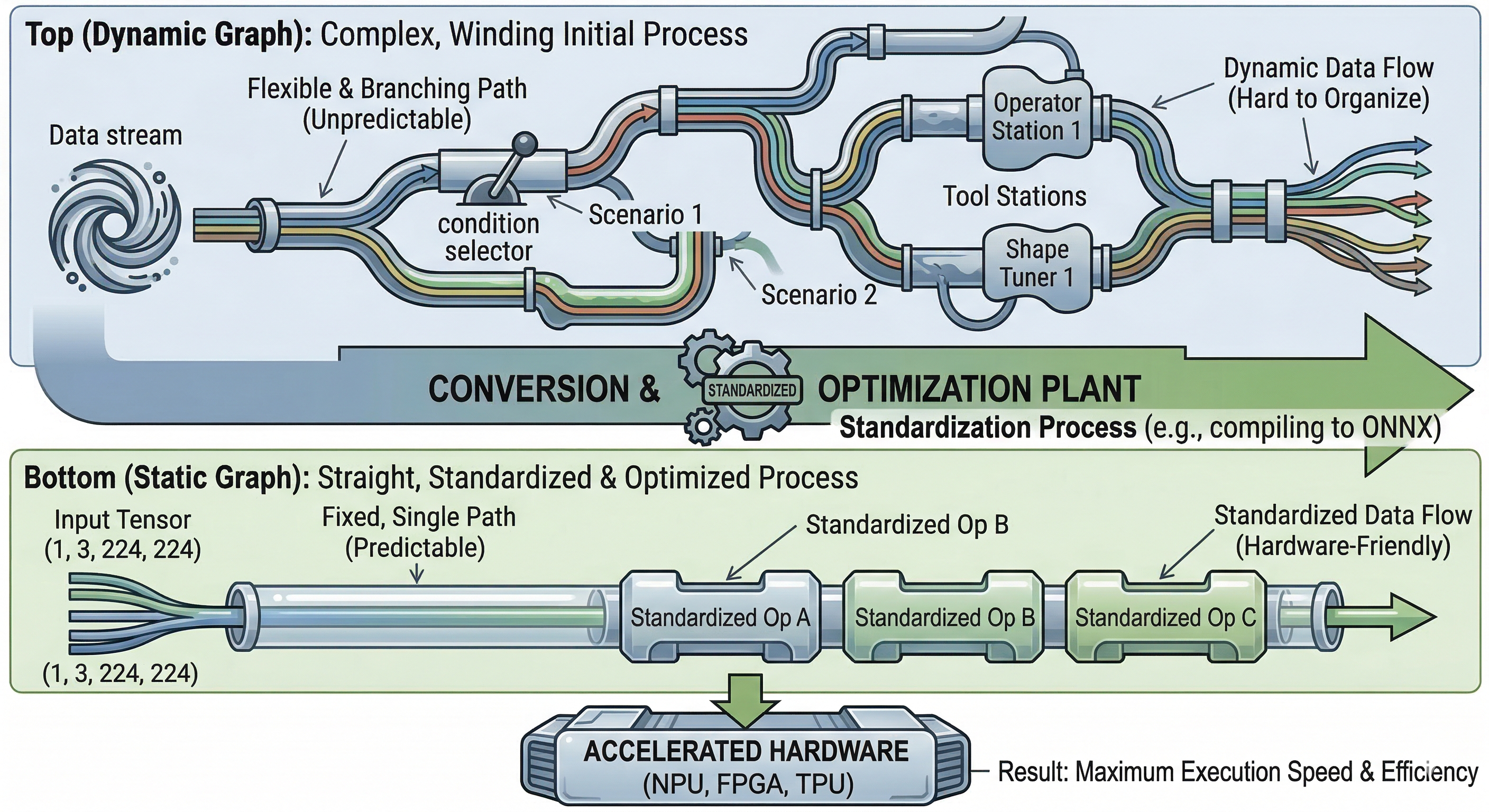

动态计算图的高昂代价

PyTorch 的核心优势在于其 Eager Execution 模式(即插即用),这也正是基于动态图实现的。在每一次前向传播中,底层都在逐层动态构建计算图。尽管 PyTorch 从 2.0 版本开始引入了 torch.compile() 来缓存计算图以弥补性能差距,但传统的 PyTorch 模型在每次执行推理计算时,仍然需要承担极高的 Python 运行时开销。

在真实的生成环境中,延迟和吞吐量直接决定了用户体验。如果把宝贵的几毫秒甚至几十毫秒浪费在解释 Python 代码以及动态调度算子操作上,那么这种用性能去换取灵活性的做法就显得得不偿失了。毕竟,一旦模型训练完毕,其架构就已经是完全固定的。如果继续在生产环境中为 Python 的“灵活性”买单,就意味着你在白白消耗原本可以用来服务更多并发请求的计算资源。

ONNX:静态图与执行提供程序

将 PyTorch 模型导出为 ONNX 格式,从根本上改变了模型的执行方式。ONNX 将模型严格表示为一张静态的有向无环图(DAG)。因为整个网络结构在执行前就已完全确定,ONNX Runtime (ORT) 推理引擎就可以在哪怕一次推理发生之前,进行大量激进的图级(Graph-level)优化。

在研发工程落地时,仅仅将 PyTorch 的推理流水线平替为 ONNX Runtime,往往就能直接实现 2 到 10 倍的速度飞跃——这甚至还没用到 INT8 量化或层裁剪等进阶技术。

这些优化包括常量折叠(Constant Folding)(提前计算好图中完全依赖静态值的部分)以及算子融合(Node Fusion)。其中,算子融合的影响最为显著:假设你的网络中有一个卷积层(Convolution)紧接着批归一化(Batch Norm)和 ReLU 激活函数,PyTorch 可能会向 GPU 下发三次独立的计算核(Kernel)调度。每次调度都会产生系统开销。而 ONNX Runtime 会将它们融合成一个高度优化的单一 Kernel,这极大减轻了内存带宽压力,并显著降低了延迟。

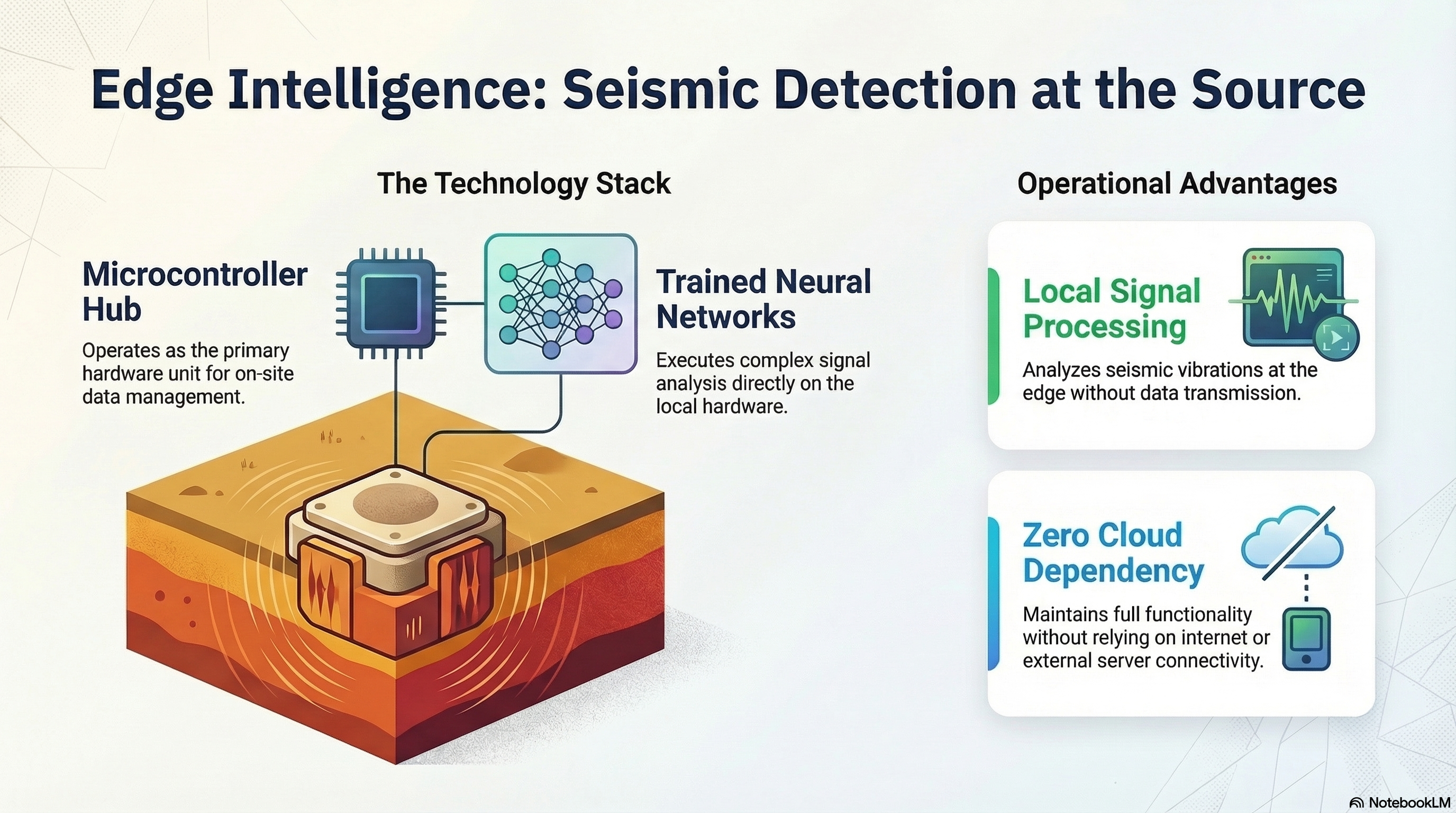

此外,ONNX Runtime 的底层是完全用 C++ 编写的,这使得它可以直接挂载特定硬件的执行提供程序(Execution Providers),例如 CUDA、TensorRT、ROCm 或 OpenVINO,从而完全绕过了臭名昭著的 Python 全局解释器锁(GIL)。这也意味着你可以将模型无缝部署到那些甚至根本不支持 Python 的环境中去,比如边缘传感器、移动端设备或者基于 C++ 的高性能服务端系统中。

工程实践:torch.compile() 与 ONNX 的取舍

随着 PyTorch 2.0 的发布,torch.compile() 已经成为了原生 PyTorch 模型加速的官方推荐方式。它利用 TorchDynamo 捕获底层计算图,并通过 TorchInductor 将其编译为高度优化的 Triton 内核代码。

尽管 torch.compile() 对模型训练的加速效果是非常惊艳的,但在构建完全解耦的纯推理系统时,ONNX 依然是王道。ONNX Runtime 的跨平台可移植性首屈一指。你可以把一个 .onnx 文件直接交给另一个用 Go、Rust 或者 C# 编写推理服务器的后端团队,完全不用考虑 Python 环境的配置。而 torch.compile 则注定将你的软件生命周期与 Python 和 PyTorch 的生态深度绑定。

局限性与边缘情况

即便 ONNX 优势明显,这种转换也绝非毫无摩擦。我们需要明确 ONNX 可能存在的短板:

- 动态输入维度:如果你的模型严重依赖极其动态的输入形状(例如 NLP 中不带 Padding 的变长序列),将其追踪(Trace)成静态图时可能会失败,或者需要极其复杂的动态维度配置,从而使得加速效果大打折扣。

- 自定义底层算子:如果你在 PyTorch 中使用 C++ 或 CUDA 编写了自研算子,它们是无法原生翻译到 ONNX 的。你必须手动编写 Symbolic 函数来把该算子映射到 ONNX 系统中。

- 控制流逻辑:如果模型的

forward函数内包含依赖于数据的循环(while-loops)或分支判断(if-statements),导出时往往最容易出错。因为导出的 Trace 过程往往只会记录假数据输入时走过的那一条路径。

平滑整合进产品管线

对于绝大多数标准架构(如 ResNets、各种 Transformer、YOLO 系列),使用

torch.onnx.export() 导出模型是极为简单的。你只需提供模型本身和一个占位假数据(Dummy Input),PyTorch 引擎就会自动追踪所有执行路径。

一旦导出完成,在应用程序中使用 onnxruntime 加载模型就能实现代码栈的完美接力。算法研究员可以继续留在 PyTorch 舒适区,使用强大的生态进行调参和模型修改。而基础架构团队可以拿着冻结的、高度优化的静态图投入生产环境,用最追求并发和吞吐量的语言把它写成服务。

即使团队还没有精力去深入研究模型量化或知识蒸馏,仅仅切换到 ONNX 也是一剂极具性价比的“开箱即用”性能强心针。对于任何追求规模化、低云端成本以及极致响应速度的 AI 商业产品而言,这都是最低挂的果实,不容错过。

成为第一个评论者。