在绝大多数关注深度学习的时代浪潮里,真正意义上的“人工智能”似乎永远如同神祇般高居在云端的服务器里。那些动辄拥有数十亿乃至千百亿参数的庞然大物,只能在装满液冷设备的机架、以及价值成百上千万的 GPU 芯片上才能艰难运转。它们在吞噬极其恐怖的电力的同时,也必须极其依赖极度稳定、极高带宽的骨干互联网连接。

然而,微型机器学习(TinyML)的出现,正在以一种最底层、最硬核的方式,彻底颠覆了这种传统的算力集中模式。它的核心奥义,就是将那些在云端被精心锤炼过的神经网络,硬生生地装进只能以“毫瓦(milliwatts)”甚至更低能耗级别运行的硅片之中。

为什么要回到边缘?物理世界的严苛审判

这种将算力“下放”的趋势,绝不只是硅谷大佬极客精神的炫技,而是由物理世界最残酷的客观规律决定的。真实世界的数据只在海量的前线传感器边缘(The Edge)产生,而绝少发生在光鲜亮丽的云数据中心里。

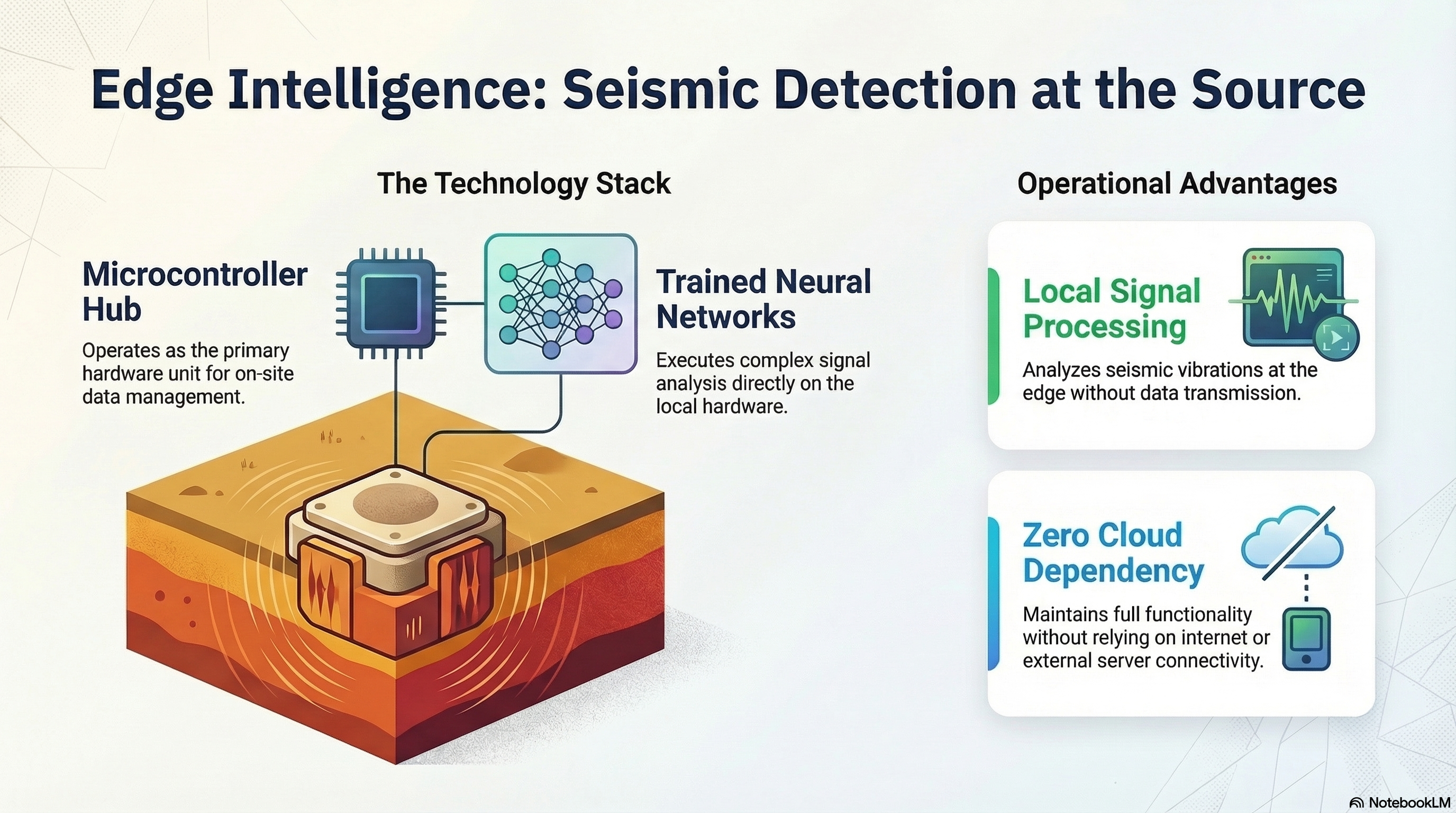

试想一下,当一台孤零零地插在俄克拉荷马州偏远荒野上的地震仪检测到微弱的晃动时,它完全无法忍受将几十 MB 的波形数据扔向云端推理 API、然后再苦等 200 毫秒才获得一个预测结果的延迟。这太慢,也太贵。它迫切需要在本地、在个位数的毫秒级别内,就干净利落地做出分类决策(“这究竟是一次真地震,还是一辆重型卡车驶过?”),并且它必须在蜂窝网络随时可能因为极端天气而彻底瘫痪的情况下,依靠自带的纽扣电池在这些偏远区域独立存活好几个月。

被极度约束的艺术:这不仅仅是“小一号的 AI”

“TinyML”绝不能被简单粗暴地等同于“缩小版的机器学习”。它在架构哲学上,强迫工程师必须彻底重构模型的整个生命周期——从最初极度保守的网络架构设计、对各种畸变数据集的精细剔除,再到最终用极其底层的 C/C++ 进行极度受限的内存规划与强电源感知的 CPU 调度。

当我们在云端(比如基于 AWS 或 Google Cloud)开发时,为了多榨取 1% 的精度而给模型随手多加两个密集层(Dense Layer),那是微不足道、且极具诱惑力的操作。但当你为像 ESP32 或是 ARM Cortex-M4 这样单薄的微控制器编写代码时,多加的那一层参数,可能在物理层面上就直接撑爆了芯片那可怜的 PSRAM 极限。一个边缘计算设备,通常要把其自身的实时操作系统(RTOS)代码、网络 TCP/IP 协议栈、传感器长数据缓冲队列、以及最后那个庞大的神经网络,这几十万人马,统统塞进那区区 2MB / 4MB / 8MB 的 PSRAM,以及外置极其逼仄的 4MB / 8MB / 16MB 的闪存(Flash)中。这里,连一个无用的字节都会遭到最残酷的绞杀。

TinyML 这门学科所带来的工程师素养,是那些习惯了用无尽的云端显卡算力去大力出奇迹的人难以想象的。在物理设备那近乎暴政般的约束下,你无法花钱充值来掩盖低劣架构的漏洞。除了拼命榨干每一滴效率,你无路可走。

重塑权重:从 32 位浮点到 INT8 整数的世界

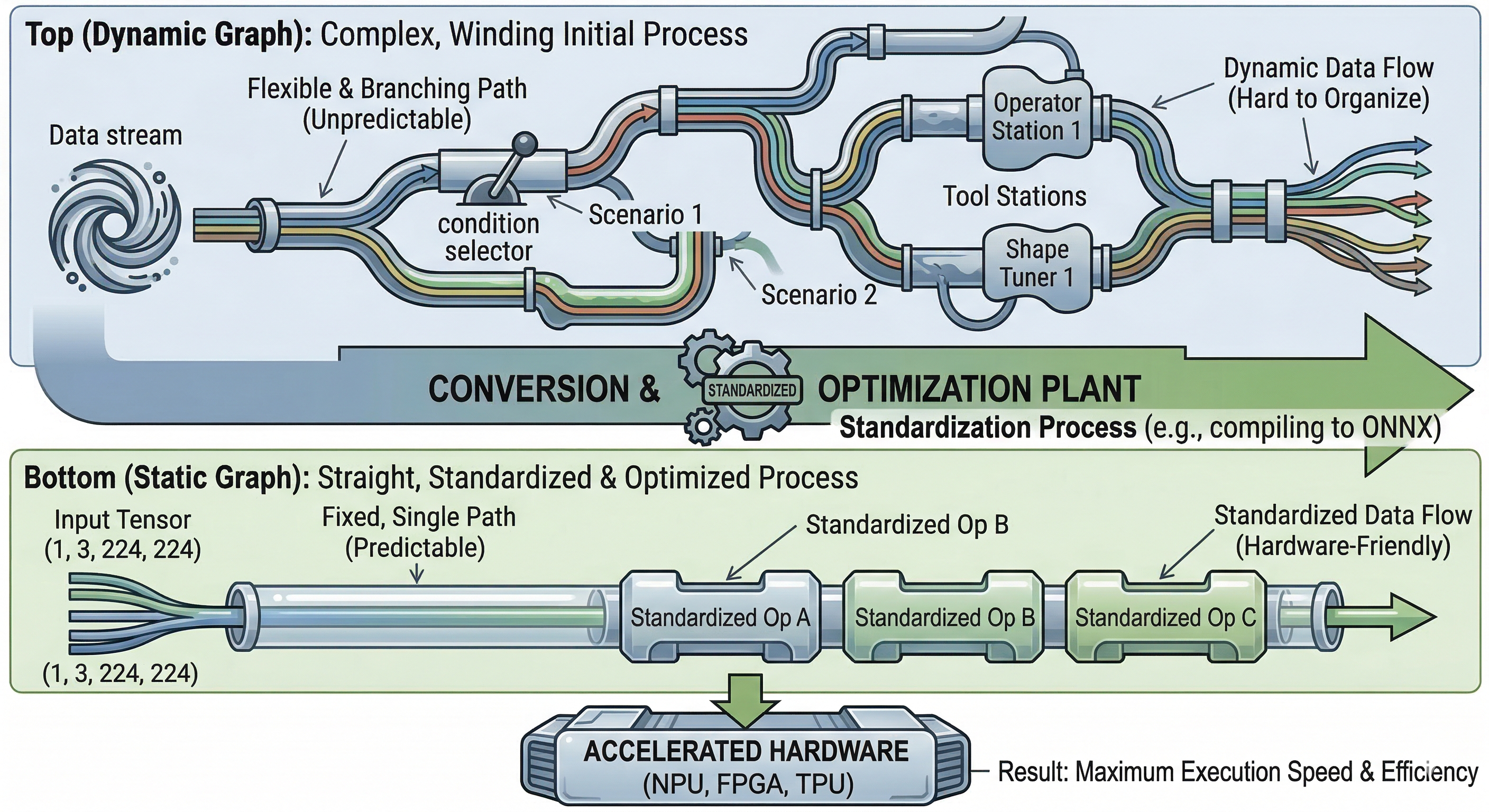

一个标准的 TinyML 产品落地流程,在起步阶段实际上几乎和巨大的云端项目如出一辙:使用庞大的算力集群,在 PyTorch 或 TensorFlow 中去训练出一个精度极高的 32 位浮点数(FP32)原始模型。然而,如果你奢望将这些 32 位浮点数直接塞进只有微型计算单元的芯片中去,无异于一场自杀。绝大多数微控制器没有配备足够强悍的专用浮点运算单元(FPU),让它们靠软件苦苦模拟浮点数乘法,其推理速度将慢如蜗牛,同时会眼看着电池电量以肉眼可见的速度直线崩盘。

此时的关键救星是训练后量化(PTQ, Post-Training Quantization)技术。这是一种堪称带有魔力的深度数学妥协:系统将神经网络中所有的 32 位浮点权重与激活值,狠狠地压缩映射成粗糙得多的 8 位整数(INT8)。这一操作,瞬间且生猛地将整个模型的文件体积和运行时内存暴降了整整 75%。令人惊叹的是,只要使用具有代表性的校准数据集进行了精细处理,这种在数字精度上大刀阔斧的“肢解”,反馈在微观识别精度上的损失往往微乎其微,甚至让人无法察觉。

随后,这个已经被量化好、极度瘦身的 TensorFlow Lite (.tflite)模型文件会被黑客般地重度处理,直接转换成一连串硬编码的 C 语言十六进制字节数组(常常借助 xxd 等工具)。这些字节将被像水泥一样直接浇筑、烧录进微处理器的固件(Firmware)中。在执行推理任务时,专门定制的 TensorFlow Lite for Microcontrollers (TFLM) 小巧引擎,将直接在没有操作系统文件系统、甚至不使用 malloc 动态分配内存的裸机环境中,极其硬核且确定地沿着这个十六进制数组解析执行计算图谱。

微型 NPU:加速器走向边缘

真正让 TinyML 迎来奇点的,是底层硅片生态爆炸般的进化狂潮。在过去,边缘侧的深度学习推理其实依然是由通用芯片(诸如老迈的 ARM Cortex-M 处理器系列)以跑软件逻辑的方式在拼命硬扛。但如今,专用的微型神经网络处理单元(Micro NPU)正在疯狂下放,被直接物理集成进边缘系统级芯片(SoC)的角落里,例如颠覆性的 Ethos-U55 或极度激进的 MAX78000。

这类专攻特定类型向量乘加运算的定制化硬件黑科技,让原本在一个常规 M4 芯片上需要咬着牙苦算数百毫秒的复杂网络,能够在短短的 20-30 毫秒内瞬间执行完毕,且只耗费几微焦耳的微弱电量。这种能耗比上的百倍级跃升,让那些曾经难以企及的永远在线 (Always-On) AI应用化为了现实。比如无间断地让系统待机监听某一句唤醒词,或者永远不眠不休地在背景中分析着无穷无尽的微地震环境底噪。这一切,现在只需要耗费一颗极为廉价的非充电纽扣电池,就能支撑好几个月乃至一整年。

深远影响:对大型科研监测网络范式的重定义

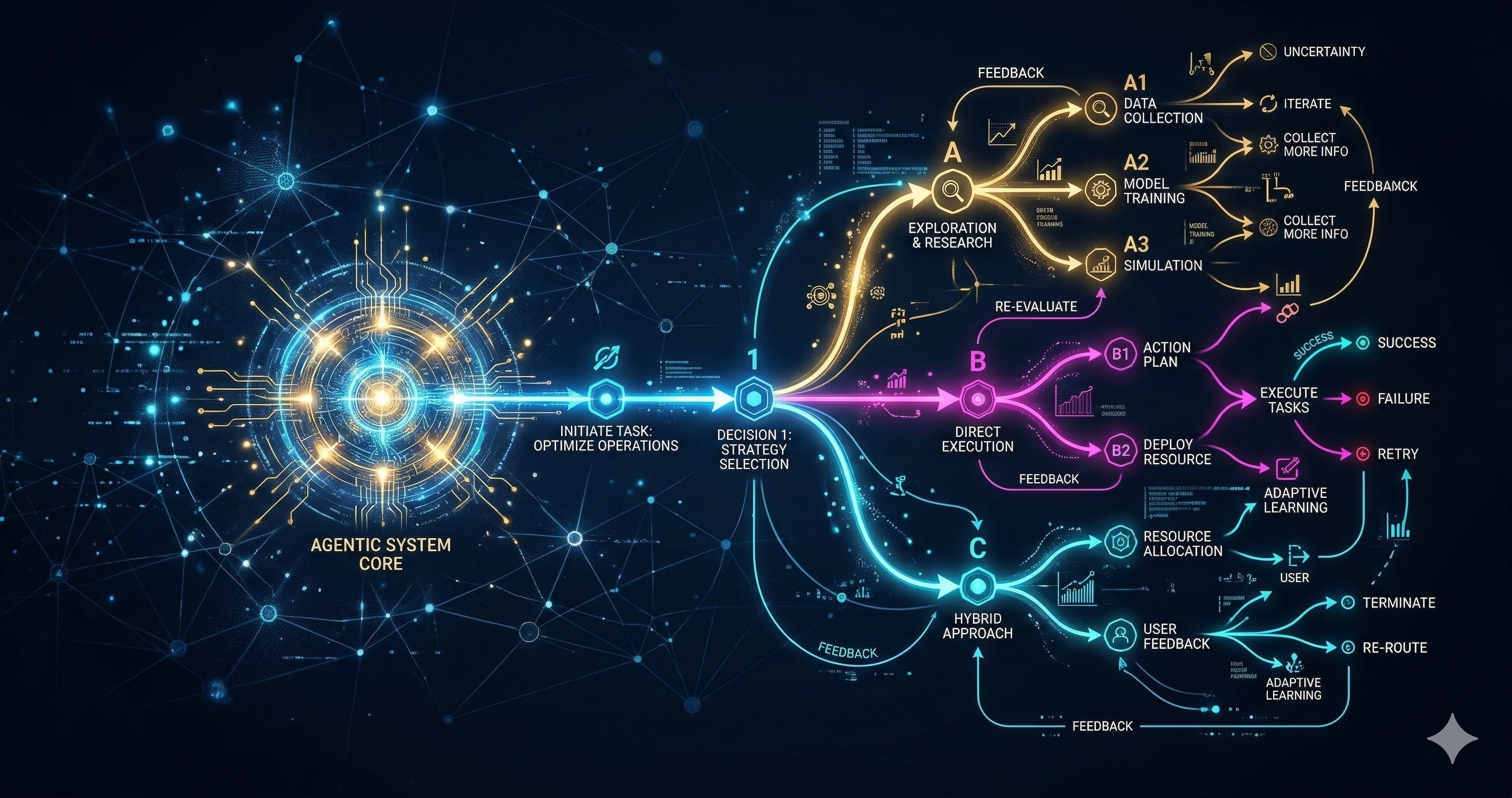

分布式 TinyML 的强势崛起,从最底层的逻辑上彻底掀翻了大规模科学传感器网络曾经坚不可摧的性能局限。

在以前,如果你想沿着一条断裂带部署 1,000 个高密度的地震台网节点,那绝对是一场灾难。你必须与电信商签订巨额的专线数据套餐,好将成千上万条令人窒息的 100 赫兹频率的连续震动数据包无脑全量砸向中央机房以等待集中算力裁决。

现在,随着拥有独立思考能力的微小神经中枢下放到每一个节点,这一切都改变了。传感器不需要再上传废话一样的背景噪音。它就死死盯在那里,在底层极其枯燥地运算着那个压缩过的 INT8 CNN 或 FP16 蒸馏模型,默默过滤。只有在这套 AI 笃定地在噪音海洋中嗅出了一丝真切的 P 波或者 S 波的前兆时,它沉睡的射频天线才会被瞬间唤醒。接着,不再是狂喷几兆的波形文件,这个被赋予了智能的小铁盒,只会向远方的指挥平台轻蔑却自信地发送区区 15 个字节的极简包:{"event": "P-Arrival", "confidence": 0.94, "timestamp": 1710777123}。发射完毕,天线光速休眠。

这一系统性的重构优势绝对是颠覆级的:整个网络的蜂窝数据消耗费用直接呈现断崖式暴降至原本的百分之一(1%)不到。这种惊人的衰减之所以发生,是因为传感器不再 24/7 不间断地传输原始的 100Hz 背景噪声流(firehose)。相反,TinyML 模型充当了智能守门员,在本地静默地极其果断地丢弃数小时的空信号。极其耗电的蜂窝射频天线只在确信检测到实际事件的罕见瞬间被短暂唤醒,以发送微小的预定义文本有效载荷。因此,原本只能用几周的昂贵特种电池现在甚至有望在无人干预的情况下硬挺好几年。更不用说,当强震真正发生、脆弱的地方通信基站全面宕机解体时,这些具备完全离线独立研判能力的智能暗哨网络,依然可以通过点对点短波、LoRa、或者卫星等碎片化弱网环境,顽强地将最核心的告警逻辑送往指挥所。

毋庸置疑,这种令人窒息的极致约束必然带来等价交换的代价:由于物理规律的限制,边缘设备上的神经网络,在其所能容纳的智识和表达上限上,注定远不及那些位于云端的百亿级巨轮来得深邃与磅礴。但在模型蒸馏(Knowledge Distillation)、硬核的结构化剪枝(Structured Pruning),以及带有精心校准的硬件感知型量化(hardware-aware quantization with curated calibration)等尖端压缩技术以超出所有人预期的速度疯狂内卷的今天,云端与泥土之间那道看似不可逾越的技术鸿沟,正以让人瞠目结舌的速度被迅速抹平。

成为第一个评论者。