地震学,从诞生之初,就是一门试图在震耳欲聋的混沌背景噪声中,去极力追寻一丝确定性物理特征的尖端学科。几十年来,那些最致命的工作——在绵延不断、如潮水般涌入的原始波形记录上,凭借肉眼的直觉和游标卡尺尺去寻找那千分之几秒的 P 波(纵波,压缩波)或 S 波(横波,剪切波)那微弱且转瞬即逝的初动抵达时刻(Onset Arrival)——几乎全部是由具有极高经验素养的地震分析师纯手工完成的。

这些分析专员手中握着的,是经过无数次盯着走纸图和屏幕熬夜培养出来的肌肉记忆与潜意识直觉。这种手工拾取(Manual Phase Picking)的精度高得令人叹服,但它却有着致命的阿喀琉斯之踵:极其缓慢、成本极高。随着现代密集型大阵列台网在全球各地的疯狂铺设,每个台站每天都会发回多达几个 GB 甚至 TB 级别的超高频原始速度或加速度底噪流。在这种体量面前,人类肉眼的算力根本支撑不起任何宏大尺度的实时处理与全自动科研预警监控。

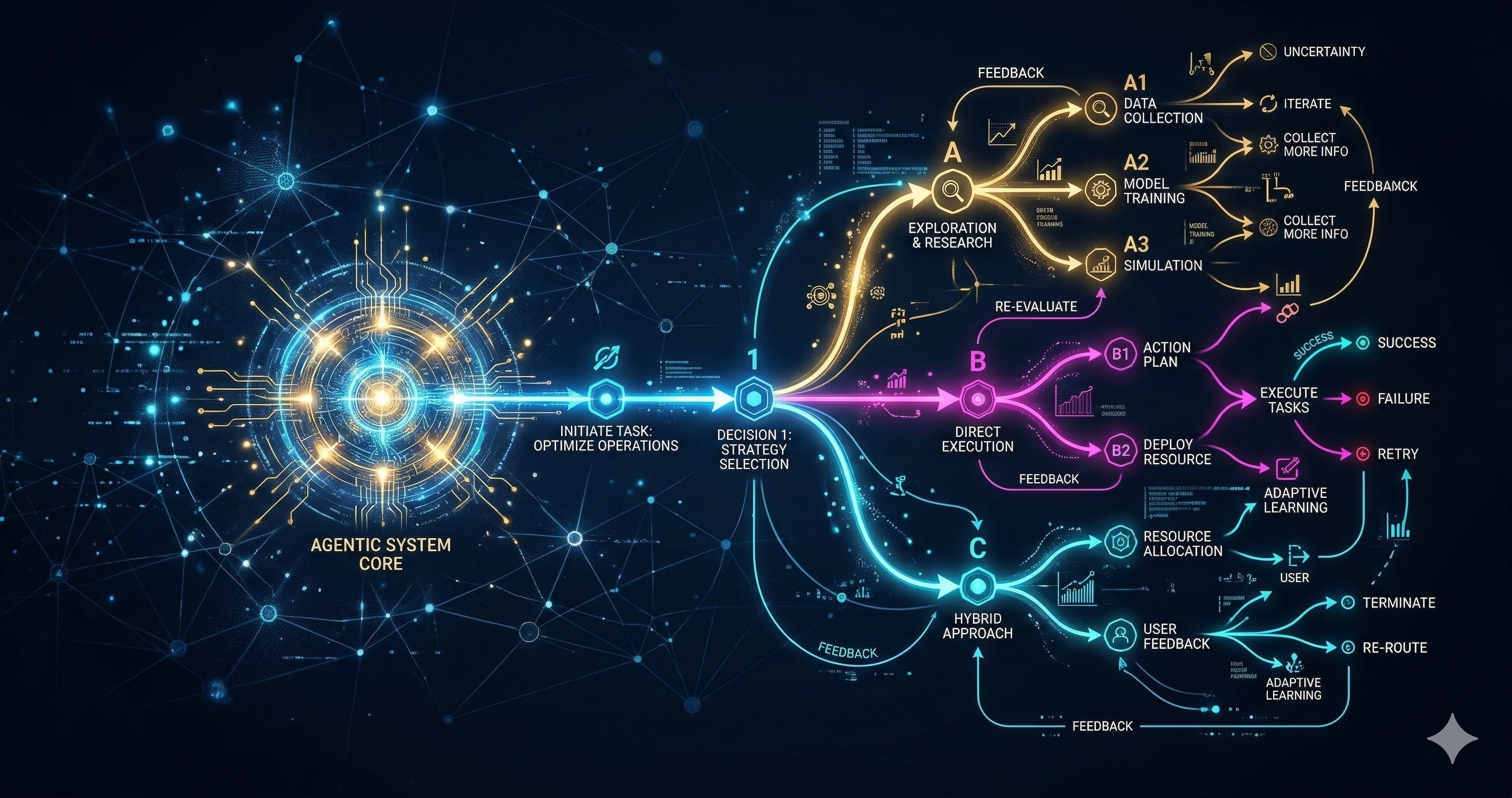

然而,深度学习时代的轰然降临,从根本上、不可逆转地彻底改写了震相微观拾取的经济学计算公式。像 PhaseNet、EQTransformer 这些有着千万量级参数的庞然大物,以及极其优化的 XiaoNet (我的工作)等诸多变体,现在完全能够以前所未见的“伪实时(Pseudo Real-Time)”模式,如同粉碎机一般吞噬着永无止境的连续波形流。它们不仅能够以极低的硬件算力和几乎为零的人工时间成本持续输出,并且其最终给定的发震初动时间戳,甚至已经极具侵略性地逼近、甚至在某些特定场景下持平了资深人类分析师的标注方差基线(Analyst-level Accuracy)。

震相拾取(Phase Picking)问题:为何毫秒必争?

震相拾取,本质是一项极其单纯但要求苛刻到神经质的分类与定位任务。它的唯一使命就是精准识别出某一种特定类型的地震弹性能量波,到底是在图谱坐标中的哪一个明确无误的绝对纳秒点,猛然冲撞了远方台站那深埋地下的传感器探头。

物理波速差异是定位的核心。通过极其精确地测量相对较快(且穿透性极强)的 P 波与随后才能慢吞吞摇晃抵达的 S 波这两者之间的绝对走时差(Arrival Time Difference),系统就能基于极度复杂的地壳区域速度模型计算出震中距。紧接着,系统会拉起至少位于三个不同方位以上的台站数据,通过立体几何的球面交汇原理(Triangulation),在几秒内锁死深埋在地下十几公里处的最初破裂点(即震源深度与震中坐标的结合体——三维震源 Hypocenter)。

在极其严肃的现代地震学研判中,零点几秒的时间残差绝对不仅仅只是某种四舍五入的“舍入误差”——它是生死攸关的界碑。仅仅 0.1 秒的初动拾取偏差,一旦被复杂的逆问题算法模型放大后投入深度迭代拟合,轻则会让计算出的震中位置凭空发生几公里甚至十几公里的恐怖偏移,重则甚至会自动在虚空中捏造出一颗所谓的“幽灵盲断层”。这种蝴蝶效应足以直接误导核电站的长期选址危害评估报告,或者全盘改写一个城市的断层面破裂几何走向结构图。

在实际的工程运行中,这事儿之所以令人窒息的难,是因为大自然根本不会好心地为你准备“干净”的教学波形图。现实世界的监测台站录得的地震波形信号如同一个大杂烩,极度脏乱且混沌:这里面混合了海浪拍打陆架激荡出的微地震共振(Microseisms)、当地重型卡车驶过引起的环境交通脉动噪声、由于电磁干扰或电缆接触不良触发的仪器随机方波突变截断,再加上最致命的灾难——来自不同走向的、因为连续破裂引发的多重诱发地震(Swarm Events),好几种不同的 P 波和相互交叠、尾波(Coda)疯狂纠缠的复杂波列相互混叠在一起,这些对于那些试图用死板规则自动触发警报的旧时代机器系统来说,无异于一场降维打击。

在被深度反向传播神经网络统治之前的漫长“旧石器时代”,整个业界仰仗的基石标准是 STA/LTA(短期平均/长期平均)等基于物理经验的经典阈值触发算法阵列。它的运转逻辑粗暴且极具工业美感:传感器窗口在源源不断的连续流中,拼命滑动计算当前那极其狭窄的一个短时间窗口内的信号振幅乘积均值,并拿它去硬刚一个极长时间段内的背景长时序均值。只有当短窗口那个数字在一瞬间骤然跃升,其比值粗暴地撕碎了那个由专家们拍脑袋设定好的保守先验警报阈值阀门(Threshold)时,系统才会大叫:“有地震了!”

STA/LTA 这种基于信号能量突变梯度的朴素思路是非常伟大的。它算法极其极简轻盈,在极其古老落后的小计算力芯片甚至单片机上都能跑得飞起,并且在对付那些信噪比极高、振幅大得夸张的明显大震时表现堪称完美。但当它被扔进那些由于信噪比(SNR)极低而导致信号几乎被碾死在地板噪底下的极微弱自然地震活动、或者是由于大量工业注水作业引发的极其细密的微小破裂震信号群中时,它就开始疯狂抽搐、频频错乱了。

它经常会极其愚蠢地被大风刮过或者工厂重锤这种非天然地震的能量突刺毛刺骗过去触发假警报。最糟糕的是,对于那些隐藏在极具破坏力的 P 波尾波混沌区域之中的,原本就不以绝对幅度爆炸见长,而是以更低频摇晃为主导的、慢悠悠且带有极大破坏性的 S 波而言,STA/LTA 甚至连发现它们存在的那丝敏锐的神经反射弧都没有。

被拉长深处的黑盒:地震专用的全变分 U-Net 网络

最尖端的前沿深度震相拾取器往往已经决绝地放弃了通过硬算绝对震动幅度比率的传统方式。现在的工业界霸主,基本上清一色采用脱胎于极度复杂的医学图像语义分割领域的 U-Net 型非对称架构引擎(Encoder-Decoder Networks)。

这种庞大的深层算力怪兽的投喂材料,直接就是完全未加过滤提取的三分量(同时监测垂直上下、南北、东西三个空间朝向)原始极高频原始数字波形图(Raw Waveforms)。极长的一段连续时间序列在涌入模型前端后,首先会被一系列级联排列的密集卷积核(Convolutional Encoding Layers)暴力碾碎。这些下采样层在时间维度上将信号以肉眼难以理解的方式疯狂收缩,无情地强行把原本冗长的时序样本高度压缩萃取成了一张极度致密、充满极高阶时间特征抽象感知的隐式张量表达矩阵(Latent Representation)。

紧接着,这团凝结着高维度时间密码的矩阵会被抛进后端极其精妙的解锁解码器阵列中。在这漫长的、试图将时间分辨率逐层放大还原(Expand and Up-sample)的回放过程中,工程师们极具创造力地安插了极为关键的跨层“跳跃连接”(Skip Connections),让前期的最高清细粒度原始波形时间位置刻度被死死焊留在最终阶段,这就如同用手术刀极其精细地剥离开迷雾一样,保证了机器找出来的那个绝对时间起跳点,在毫秒级微观尺度下清晰得令人发指。

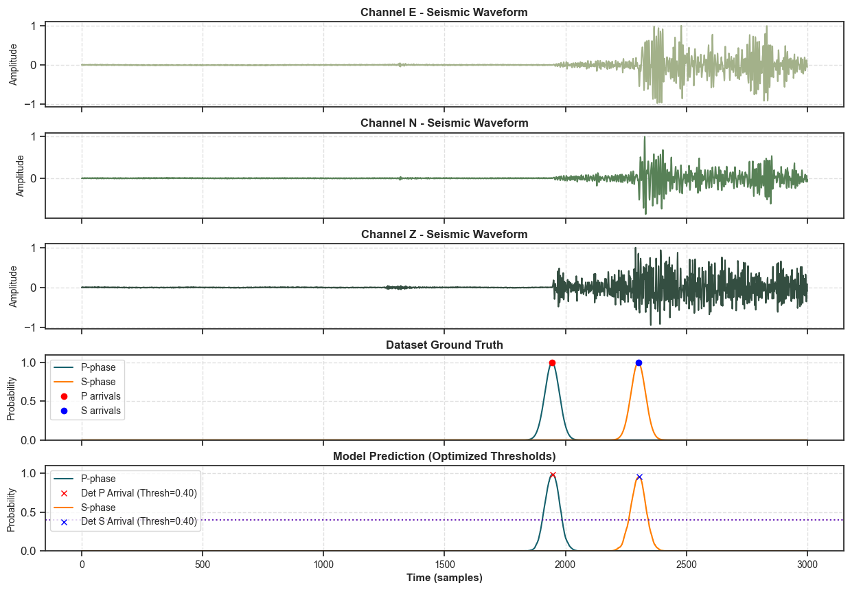

这个极度深邃的人工大脑最终从输出端口吐出的,再也不是那种古板愚蠢的一刀切式“有警报 (1)”或者“无警报 (0)”的弱分类标签。它是极为震撼的三条互相缠绕的、且沿着每一毫米流逝的原始时间轴极度细腻输出的高分辨率连续概率时间流:一条是纵波(P-Wave)极其笃定的到时降临概率包络、另一条是毁灭性的横波(S-Wave)到达概率分布曲线,剩下的一条则是系统对自己眼下只身处在纯净废噪环境中的概率声明。接下来只要使用算法在这几条圆滑的山脉概率峰顶上精准地掐出一个峰值极值(Peak Detection),就可以轻飘飘地将那些比极小毫秒切片的时间点榨取出来了。

悬在头顶的倒计时:警报系统的极限延迟博弈

当这一整套极尽复杂的庞大深度模型技术,被直接搬到用于拯救百万城市人口的地震预警(Earthquake Early Warning, EEW)系统中时,我们才会切身体会到,原来理论的极限精确度和残暴的现实时间延迟之间,存在着让人几乎绝望的冰冷零和博弈。

在那种与死神赛跑的紧急警报场景下,每一次为了等待下一段更完整的余波缓冲进电脑而多浪费的那致命的一秒钟缓冲,或者是那为了跑透那个有着上亿个矩阵乘法的巨大网络而在推理机器上多干掉的那半秒钟执行加载,都意味着直接从远方某个处于强震破裂前方的下游脆弱城市的民众、飞驰而过的满载高铁列车那宝贵的撤离与拉闸迫降生命窗口里,无情地硬生生被直接克扣掉了一秒钟。

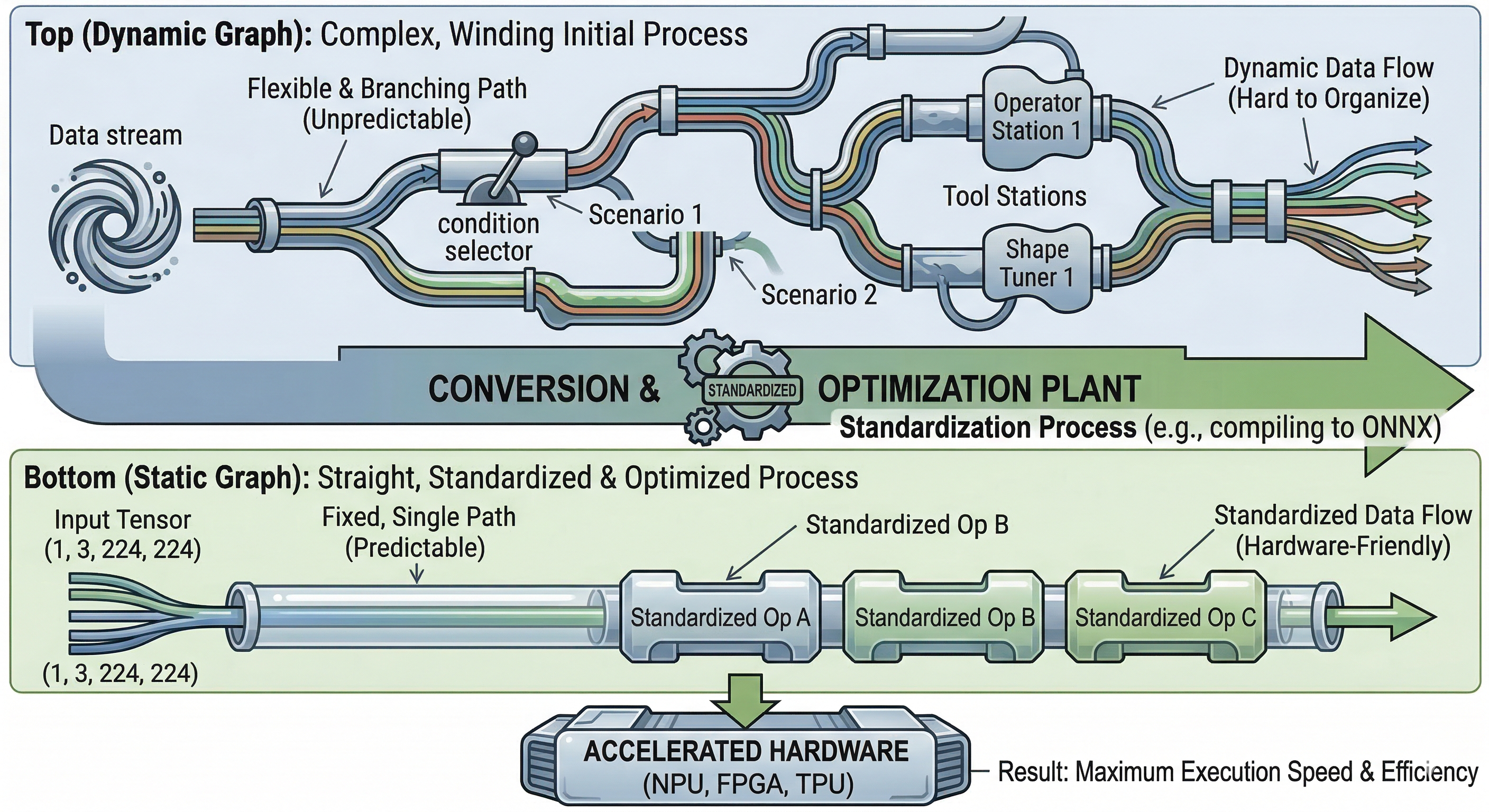

这种极致的压迫感,甚至逼着整个领域的模型架构工程师们做出了极其痛心的妥协倒退。因为在那些纯学术领域的黑箱里,像双向长短期记忆网络(Bi-Directional LSTMs)或者是极其可怕的前沿堆叠式变压器架构网络(Deep Stacked Transformers),它们确实总是能在最终提交的回溯审查实验里,凭借它们像上帝视角般可以放肆“疯狂朝时序流未来后向偷看”的非因果霸道特权,刷出傲视群雄、极尽奢华的完美震相检出率。

但是,那些疯狂的非纯因果架构引擎因为在计算出此刻数据答案之前,需要提前要求并痴痴呆呆原地空载去苦苦缓冲好几秒甚至是更长几秒甚至以秒为单位未来还没到来的前瞻时间切片,这在要求绝对零延迟瞬间开火的 EEW 实战报警前线,其所带来的致命延迟缓冲几乎是如同谋杀一般,被实战操作层坚决一票否决。这也就是为什么,即便到了眼下这各种深度模型满天飞的时代里,那些在时间轴上结构极为简陋原始、坚决不往未出生时间盲端倒退一步的极端原教旨主义的极简纯因果单向卷积架构(Pure Causal CNNs),依然是各方在真实报警红线上苦守阵地死磕时必须强硬采用的唯一标准核心火力——因为只有它们的运算延迟是在这片混沌天地间唯一那套处于极限可控、坚如磐石状态下的确定性延迟死线法则。

而在远离那些用金钱和极致算力堆砌出来的中央超级云计算堡垒的边缘地带,如果要在野外极寒或是酷热严酷自然环境下部署这套最智能的拾取器——哪怕仅仅只在一片巴掌大小、搭载于一个最基础廉价的微控制器上的极其逼仄狭小的极限算力芯片内——我们需要做的,远远不止于在软件端做那些细枝末节的修改微调了。我们必须在这个极其脆弱且计算资源贫瘠不堪,连一条像样的持续高速通信互联网网线保障都没有提供给它的硬件深渊中找寻方案。这个时候,前沿学科里的微型边缘侧机器学习部署学(TinyML)和极致恐怖的知识蒸馏算法(Knowledge-Distillation)技术流水线的救场属性变得无比生死攸关且关键:通过用极其暴力的数学映射手法,把极其高耸入云的宏大原生网络参数硬塞到一个使用最低端粗糙整数定点格式运算、完全塞满在那些只有区区几十KB临时存储运算缓冲区的极致浓缩的强架构残余体系中去进行不间断的全时运算。也只有在这种极致瘦身和残暴截断下实现的低功耗边缘持续独立推理和报警检测能力体系被最终搭建完成,这个拥有了真正自我裁决智能的单个末世暗哨终端台位感应器,才能真正有底气做到只把那些几乎已经是百分之两百确定无误的高危报警判定结论和事件警讯参数流文件发往总部,进而成功躲避并绕开原本依靠极其蠢笨全开波段强迫上传所引发的那种网络灾难式挤兑的下沉终局命运。

成为第一个评论者。