一个基于海量静态互联网语料库训练出的大型语言模型(LLM),从数学上注定了它永远无法原生知晓上个月刚刚发表了什么论文。它无法读取那篇足以推翻它根深蒂固结论的最新预印本,无法获取能够挑战它基本假设的开源数据集,更无法获悉原始研究中被纠正过的错误。

如果仅仅是用于日常聊天、辅助创意写作或生成程式化的代码片段,这种知识的滞后性是可以容忍的。但对于极度讲究严谨性的科学工作(如固体地球物理、前沿医学探索)而言,准确性、数据溯源脉络以及对最新文献的掌握是最高准则。对于科学验证系统来说,一个带有“时代局限性”的静态大脑,以及大模型那信誓旦旦的“幻觉(Hallucinations)”缺陷,无疑是致命的,它们甚至会直接摧毁使用者对整个系统的信任。

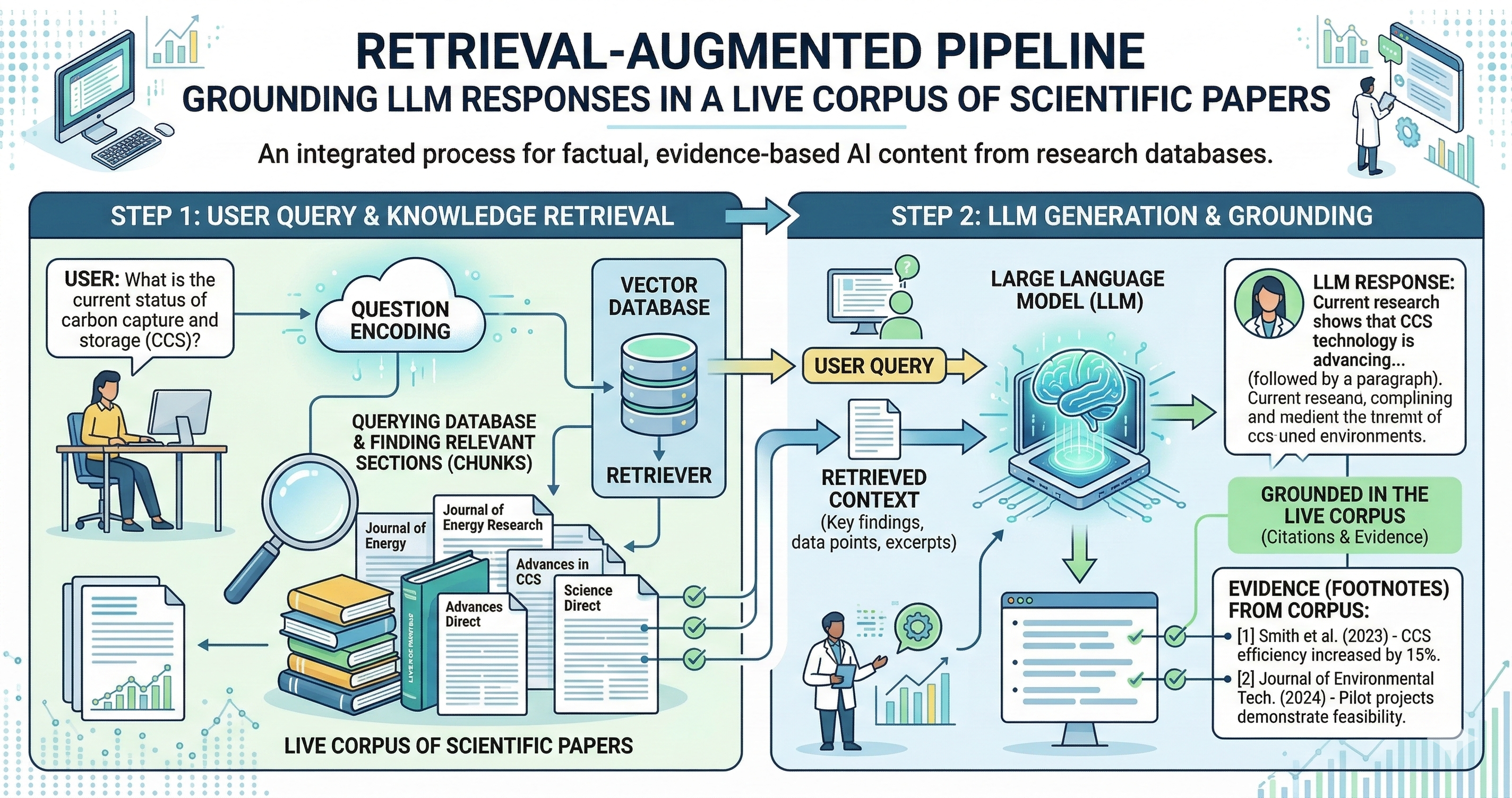

检索增强生成(Retrieval-Augmented Generation, RAG)正是为了解决这一痛点而诞生的。与其强迫模型从它那几十亿被固化的参数权重(参数记忆)中凭空回忆具体事实,RAG 选择在用户提问的当下,从外部可靠的数据库中实时检索相关文档,将这些“证据”作为上下文注入到 LLM 中,并强制模型的回答必须锚定在这些外挂背景之上。这样一来,它不再是一个试图硬背整座图书馆全知道的“数据库”,而是回归到了它最擅长的角色:一台强大的逻辑推理与文字合成引擎。它的每一次断言,都变得有据可查。

科学级 RAG 系统的核心架构

一个专门用于解析科研文献的健壮 RAG 流水线,往往由三个核心层级构成。

1. 索引层(The Indexing Layer): 一切始于离线数据处理。科学论文的 PDF、arXiv 上的 XML 预印本、结构化的观测数据表被海量吞入系统。由于科研论文通常极长且逻辑极其连贯,而大语言模型的上下文窗口容量有限,这些长文档必须被智能切分成互相重叠的较短“文本块”(例如每块 500 个 Token)。紧接着,极具针对性的文本向量化模型(Embedding Model)会将每个高维文本块压缩成低维稠密向量。最终,这些代表着语义特征的向量矩阵,连同文本明文以及作者、DOI编号、发表日期等高价值元数据,统统存入专门的向量数据库(如 Pinecone、Milvus 或开源的 FAISS)。

2. 检索层(The Retrieval Layer): 这个阶段在用户查询时实时触发。当用户用自然语言丢出一个疑问时系统会将其通过相同的 Embedding 模型转换为“查询向量”。向量数据库随后启动近似最近邻搜索(ANN),在浩如烟海的百万级向量池中高速扫描,找出欧氏距离或余弦张量角度上最接近的特征块,并将打分最高的 K 个知识片段顺次提取出来。

3. 生成层(The Generation Layer): 最后的集大成步骤在于综合与输出。提取出的切块会连同用户的提问,一起组合进针对 LLM 精心设计的系统提示词(Prompt)中。这个提示词会包含冰冷而严厉的指令:“仅使用以下提供的前提素材来回答问题。如果你在素材中找不到答案,请直接回答‘我不知道’。” 最终,语言模型基于这些严丝合缝的第三方真实上下文,输出逻辑连贯、言之有物的系统回答。

外部检索步骤绝不只是为提示词增加了几个段落的信息,它从根基上改变了大模型生成的“认识论”本质。所有的声明不再是由模型那些隐晦黑盒般的先验概率决定,而是完全依仗可验证的客观铁证。

RAG 在地震学研究中的降维打击

在像地震学这种高度依赖观测数据、科研体系极其成熟的实体物理科学中,历史文献浩如烟海,横跨几十年的各州台网年度报告、USGS(美国地质调查局)公告集,以及分布在各类垂类期刊中纷繁复杂的算法演进史。对于研究人员来说,想要进行一份全面细致的综述,往往是折磨人的。此时,RAG 的实战价值便凸显无疑。

设想一位学者抛出这样的检索请求:“在 2018 年至 2024 年期间,都有哪些针对俄克拉荷马州诱发地震的自动化震相拾取(Phase Picking)算法被实际部署了?”

如果在传统的 Google Scholar 上搜,你需要花好几个小时反复更换关键词、下载几十篇长达十几页的论文,并逐字段落强读去比对各团队的实验方法。但一个基于地震学专门构建语料库建立的 RAG 系统,能在几秒钟内抽取出那些最相关的算法对比表、作者附属机构以及针对特定数据集性能优化的关键段落。

更关键的是,RAG 给出的答案是完全可核查的(Verifiable)。传统的闲聊 LLM 最臭名昭著的陋习就是极度自信地虚构出一篇从不存在的论文,而设计良好的 RAG 在生成答案时始终挂载对出处的高亮超链接。科研人员可以一键跳转至原始文献页面,对照原文评估上下文是否存在断章取义。人工智能绝不是取代了学界严谨的判断,而是为科研发现铺设了一条高速公路。

进阶玩法:超越简单的向量搜索

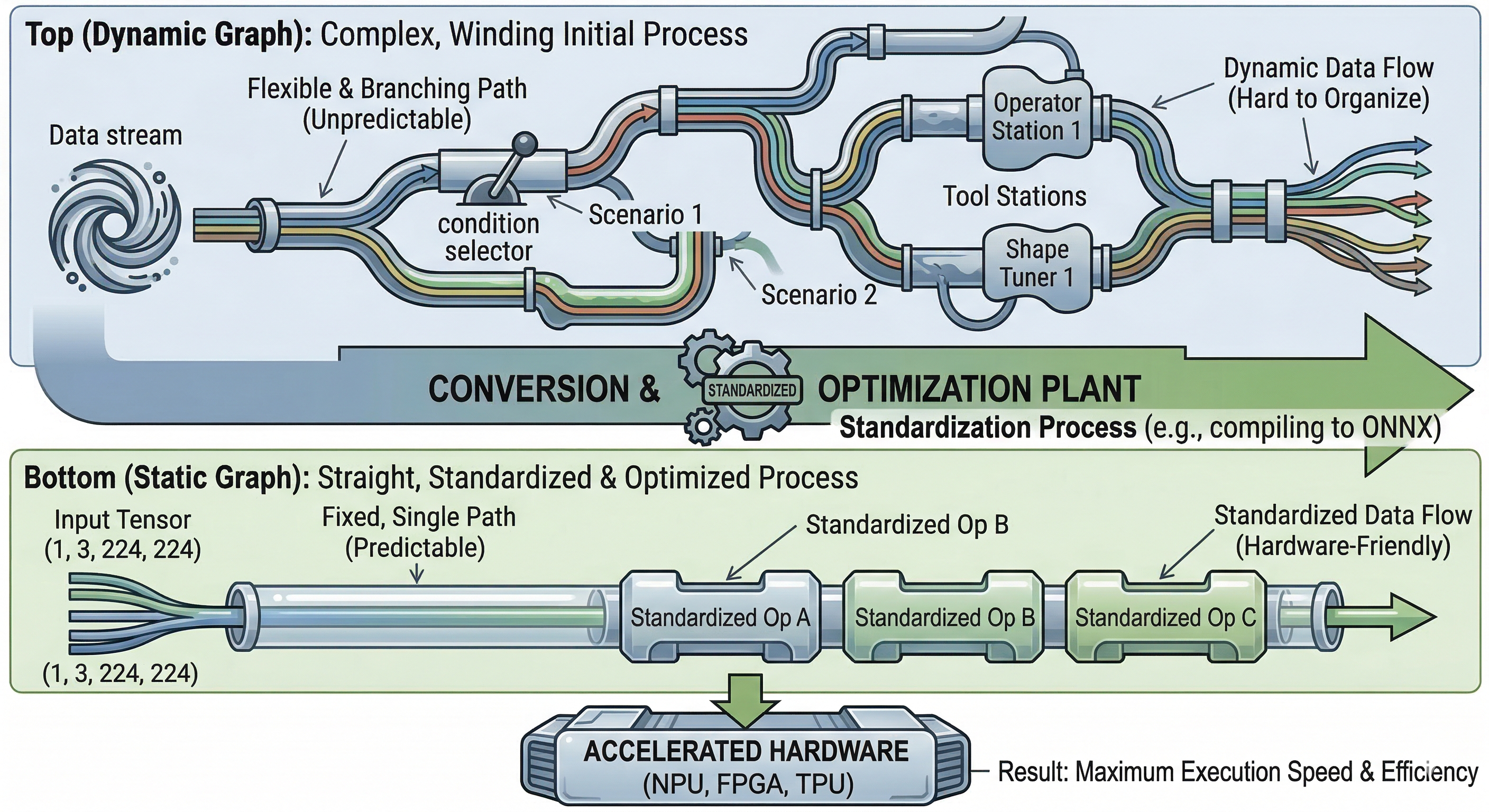

随着 RAG 架构走向工业级深水区,纯粹的低维向量相似度匹配已经很难满足垂直科学领域的极限需求了——在这些领域,硬生生的特定术语(Keyword)匹配往往和玄之又玄的语义相关性同样致命。

现代科学范式的 RAG 几乎都会采用混合检索(Hybrid Search)策略。它将稠密向量表征与传统的稀疏关键字算法(典型的例如 BM25)强强融合。这样就能确保当你查询诸如 "STA/LTA" 或者 "PhaseNet" 这种极度专指的特有名词时,系统绝对能召回那些出现了这类字符串的文件,而不只是给你一堆概念模糊类似的内容。此外,重排序(Re-ranking)技术的注入也必不可少:系统先用超快重量很轻的模型捞出来 100 篇内容,紧接着喂给更加复杂的交叉编码器(Cross-encoder)神经网络,针对问题与文档的绝对匹配度重新精确打分排序。最终,只把最精华的 5 个块喂向耗资巨大的语言模型接口。

RAG 无法掩盖的根本短板

尽管大受追捧,RAG 并非银弹。由于整个系统的上限被检索端彻底锁死,因此 "Garbage in, garbage out" (垃圾进,垃圾出)的铁律在此尤为残忍。如果你的文档切片过于暴力直接把一句话劈断,如果你用来降维的 Embedding 模型很蠢甚至没认全学界行话,又或者你灌入系统的知识盲区太大,都会导致后面 LLM 收到的都是一知半解的碎片,输出的结果自然支离破碎。

检索引入了一种隐蔽且全新的故障模式:假如系统非常听话地搜索到了一段完全过时的错误结论或者被伪造的研究,LLM 是没有能力去越俎代庖判定这段铁证是否有猫腻的。它只会以极其流利且具有说服力的逻辑,基于这段错误的基底材料向用户做一次极其精彩的科普。大模型会默认你塞给它的知识块就是绝对的数学真理。

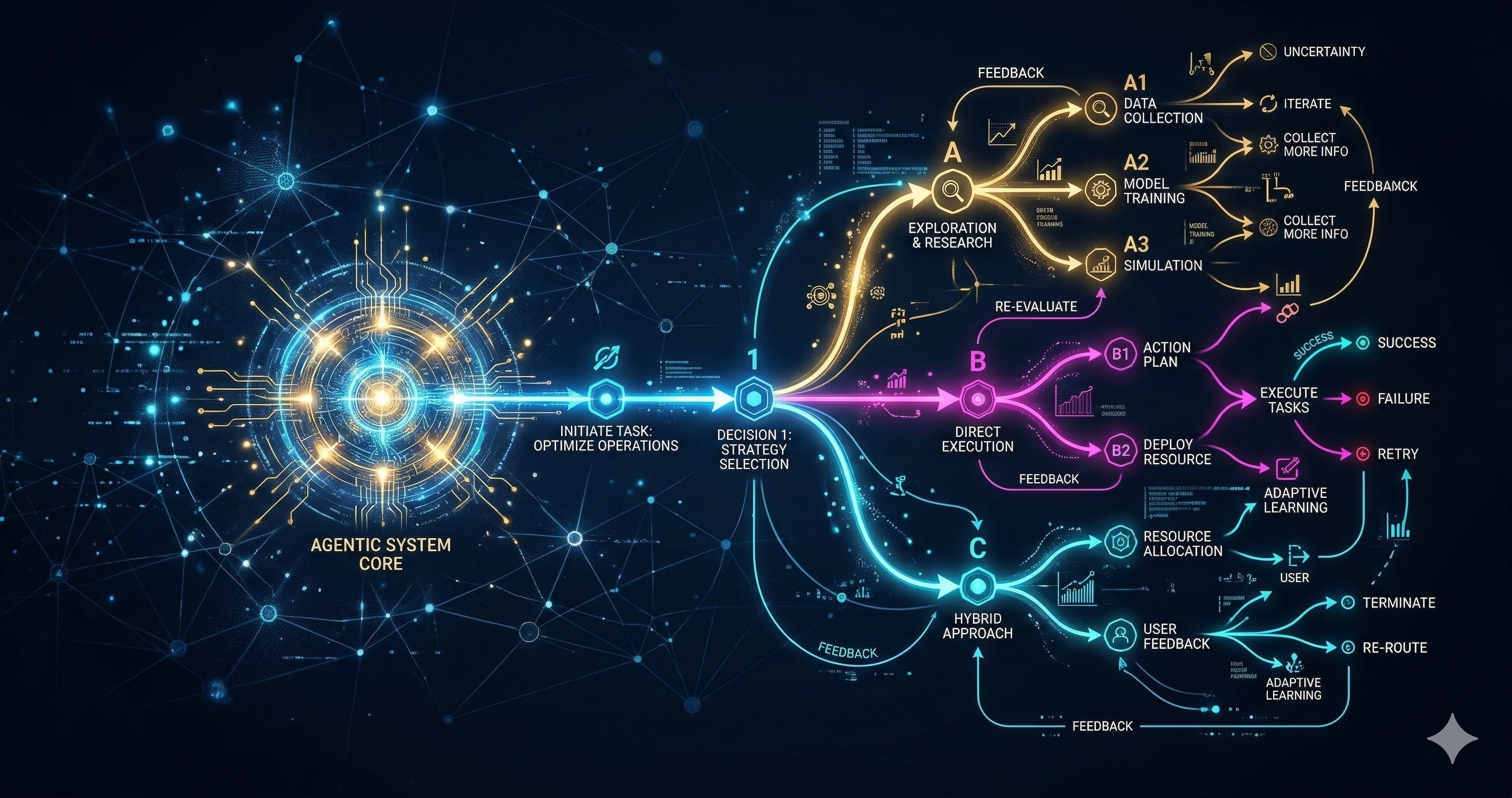

对于新兴的“智能科学代理工作流(Agentic Scientific Workflows)”而言,当一个高级 AI 架构尝试自主查阅海量文献,从而借此形成新假设、筹备新试验、甚至是评估相互冲突的模型预测时,稳健且极为高保真的 RAG 基建绝不再是一个可有可无的酷炫功能。它是决定系统底色的地基。将文件吃进去、聪明地切块、并在关键时刻百发百中地提取回来——构建并迭代这一段架构的难度,完全可以与选择一个更聪明的、有成百上千亿参数量的大模型相媲美。

成为第一个评论者。